Analytische Überlegungen zum Start in das Jahr 2026

Zum Jahresende 2025 bin ich im Newsletter von Ethan Mollick auf inspirierende Überlegungen gestoßen. Der Bestseller-Autor (Co-Intelligence) und Professor der Wharton School in Pennsylvania beschreibt in „The Shape of AI: Jaggedness, Bottlenecks and Salients“ zentrale Strukturmerkmale gegenwärtiger KI-Systeme. Anhand dieser Merkmale erklärt er, warum KI in bestimmten Bereichen sehr schnell Fortschritte macht, während sie in anderen auffällig begrenzt bleibt – und welche Folgen sich daraus für menschliche Arbeit und institutionelle Kontexte ergeben. Zum Start in das Jahr 2026 möchte ich seine Ausführungen als Analysefolie für aktuelle Entwicklungen im Bereich Künstlicher Intelligenz in Schule und Unterricht nutzen und meine Gedanken zur Diskussion stellen.

Engpässe als Grenzen und Motoren von Entwicklung

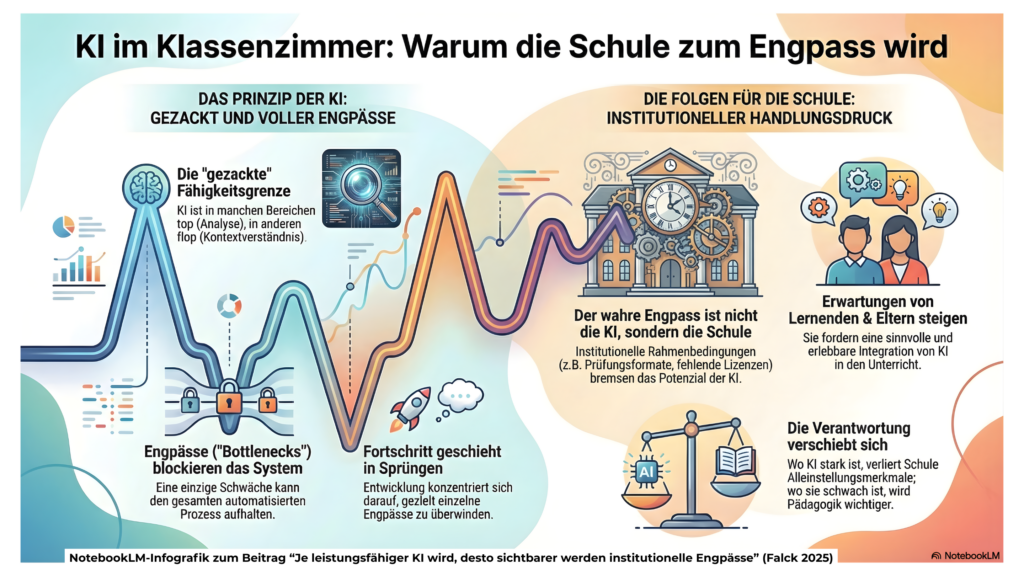

Zentral ist die von Mollick verwendete Metapher der „Jagged Frontier“, der diskontinuierlichen und deshalb gezackten Fähigkeitsgrenze von KI. Gemeint ist eine ungleichmäßige Verteilung von Kompetenzen: KI-Systeme sind in der Lage, komplexe analytische Aufgaben, medizinische Differenzialdiagnosen oder anspruchsvolle mathematische Berechnungen sehr zuverlässig zu bewältigen, zeigen jedoch deutliche Schwächen in Bereichen wie Gedächtnis, Kontextbindung oder situativer Angemessenheit. Diese Unregelmäßigkeit erklärt er als strukturelles Merkmal der aktuellen Systeme.

Besonders relevant ist in diesem Zusammenhang Mollicks Hinweis, dass bereits einzelne Schwachstellen ausreichen können, um ganze Arbeitsprozesse zu blockieren. Solche Schwachstellen bezeichnet Mollick als „Bottlenecks“, also Engpässe im Sinne systemischer Flaschenhälse. Solange sie bestehen, lassen sich Prozesse nicht vollständig automatisieren – selbst dann, wenn die KI in vielen Teilaspekten sehr leistungsfähig ist. Ein System ist immer nur so funktional wie sein schwächstes Glied.

Als Beispiel führt der KI-Experte die Erstellung von Präsentationsfolien an, die mit KI bislang unzureichend automatisiert werden konnte. ChatGPT und Co. lösten das lange Zeit über das Erstellen von Code, so dass zwar inhaltlich korrekte, aber grafisch einfache und nur eingeschränkt brauchbare Outputs entstanden. Die vermeintliche Lösung brachte schließlich Googles Bildmodell Nano Banana, das in Gemini bzw. innerhalb von NotebookLM Folien per Bildgenerierung erzeugt. Diese sind bis auf geringe Schwächen grafisch anspruchsvoll, inhaltlich steuerbar und bald wohl auch bearbeitbar.

Leistungsfortschritte bei KI-Systemen vollziehen sich vor diesem Hintergrund also nicht gleichmäßig, sondern punktuell entlang der Engpässe. Es ist davon auszugehen, dass an diesen Stellen mehr investiert wird, bis sich der „Knoten“ löst und dann dynamische Entwicklungen zu verzeichnen sind. Der Historiker Thomas Hughes beschrieb vergleichbare Phänomene in der Technikgeschichte als „Reverse Salients“, so Mollick in seinen Ausführungen: gemeint sind einzelne technische oder soziale Rückstände, die die Weiterentwicklung eines Systems aufhalten, bis sie gezielt bearbeitet werden und es zu einem sprunghaften Entwicklungsschritt kommt. Immer dann, wenn ein Engpass bearbeitet wird, verschiebt sich die Fähigkeitsgrenze, sodass neue Anwendungsfelder, aber auch neue Engpässe entstehen.

Für den Blick auf KI bedeutet das: Wer verstehen will, wie und wohin sich Systeme entwickeln, sollte weniger auf allgemeine Leistungsindikatoren (Benchmarks) schauen als auf technisch-funktionale Engpässe, deren Lösungsbemühungen und die dann entstehenden sprunghaften Veränderungen. Zudem lässt sich besonders an diesen Stellen beobachten, wie das Verhältnis zwischen Mensch und Maschine immer wieder neu austariert werden muss.

Was heißt das für Schule und Unterricht?

Überträgt man diese Überlegungen auf Schule und Unterricht, wird deutlich, dass auch hier bestimmte Engpässe weitere Potenziale blockieren. Dies gilt zum Beispiel beim Einsatz von KI in bewertungsrelevanten Situationen bzw. bei der Korrektur. Auch wenn sich viele Lehrkräfte an genau diesen Stellen Entlastung wünschen, erschweren nicht hinreichend reproduzierbare KI-Outputs und Datenschutz-Regelungen den Einsatz automatisierter Korrekturverfahren. Ein weiteres Beispiel sind komplexe und qualitativ hochwertige Lernmaterialien. Diese können zwar von aktuellen KI-Systemen erstellt werden, passen dann aber nicht zwingend zur konkreten Lerngruppe und erfordern aufwändige Anpassungen. Und zuletzt zeigen sich schulische Begrenzungen auch bei der individuellen Lernstands-Diagnostik, bei der Kontinuität in der Begleitung von Lernverläufen über längere Zeit sowie bei der Unterstützung sozialer und kooperativer Prozesse durch KI.

Wo befinden sich schulische Engpässe?

Bei näherer Betrachtung liegen diese Engpässe jedoch nur teilweise an den fachlichen Fähigkeiten der KI. Oft fehlt es eher an geeigneten Tools, die DSGVO-konforme Automatisierungsprozesse mit KI ermöglichen. Oder es fehlt an Kompetenzen, datenschutzkonforme Lösungen vor Ort umzusetzen – zum Beispiel bei der Installation lokaler KI-Modelle.

Zu guter Letzt scheitert[1] das Einlösen KI-spezifischer Potenziale auch an schultypischen Routinen und institutionellen Rahmenbedingungen, die sich als besonders veränderungsresistent erweisen. KI kann beispielsweise lernförderliches Feedback generieren und Schüler:innen individuell unterstützen. Wenn jedoch Geräte, Software-Lizenzen oder verlässliche Nutzungskonzepte fehlen – oder wenn Unterricht primär auf die nächste Klassenarbeit ausgerichtet ist –, kann formatives KI-Feedback sein Potenzial nicht entfalten. Ähnliches gilt für Förderstrukturen, die häufig fragmentiert oder wenig systematisch angelegt sind. Oft rücken sie erst nach formalen Diagnosen in den Blick, obwohl KI-Systeme bereits früh Hinweise auf Lernstände und Förderbedarfe geben könnten. Hinzu kommt, dass Prüfungsformate weiterhin stark produktorientiert sind, obwohl generative KI einen Großteil klassischer Aufgabenformate lösen kann und damit die Frage nach einer stärkeren Prozessfokussierung unausweichlich wird.

Erwartungsverschiebungen bei Lernenden und ihren Eltern

Mit der zunehmenden Leistungsfähigkeit von KI-Systemen werden diese Begrenzungen sichtbarer. Zusätzlich werden Erwartungen erzeugt und verstärkt, die ebenfalls auf die Schule zurückwirken. Damit ist gemeint, dass entlang der Linie der technischen Möglichkeiten Erwartungen entstehen, diese Möglichkeiten in Schule und Unterricht auch auszuspielen. Lernende wollen beispielsweise, dass ihnen der sinnvolle Umgang mit KI nicht nur erklärt, sondern auch im Unterricht erlebbar gemacht wird. Damit sind Lehrkräfte didaktisch und organisatorisch gefordert, KI als Thema, als unterstützendes Werkzeug sowie als Instrument zur Steuerung von Lernprozessen zu verstehen und einzusetzen.

Ähnliche Erwartungsverschiebungen zeigen sich auch auf Seiten der Eltern. 2026 dürfte noch mehr schulische Bildungsarbeit im Kontext von KI eingefordert werden – etwa in Form von Aufklärung, der Förderung von Medien- und Urteilskompetenz oder durch den gezielten Einsatz neuer Potenziale zur individuellen Lernbegleitung. Öffentlichkeitswirksame Initiativen und Auszeichnungen wie der KI-Schulpreis der Deutsche Telekom Stiftung dürften diese Erwartungen weiter verstärken.

Institutionelle Engpässe

KI-Systeme sind zwar prinzipiell in der Lage, einzelne Anforderungen zu bedienen, können diese Erwartungen jedoch nicht kohärent in den schulischen Alltag integrieren. Genau hier wird ein weiterer institutioneller Engpass sichtbar, der uns im neuen Jahr beschäftigen wird. Die Integration solcher Erwartungen ist keine technologische, sondern eine organisatorische und pädagogische Aufgabe. Sie betrifft Schulentwicklung und Fortbildung zur Etablierung professioneller Standards insgesamt, zum Beispiel hinsichtlich einer KI-integrierenden Feedbackkultur, individueller Förderung, dem Umgang mit Heterogenität sowie der Weiterentwicklung von Prüfungs- und Bewertungspraxen. Diese Prozesse lösen sich nicht von selbst oder lassen sich an einzelne experimentierfreudige Kolleg:innen delegieren, sondern müssen von Schulleitungen und Lehrkräften initiiert, ausgehandelt und kontinuierlich verfolgt werden.

Was wir 2026 spüren werden

Meine These zum Start in das neue Jahr lautet: Je leistungsfähiger KI wird, desto sichtbarer werden diese institutionellen Engpässe. Es ist daher davon auszugehen, dass wir den daraus resultierenden Veränderungs- und Handlungsdruck im Jahr 2026 noch stärker spüren werden. Die gezackte Fähigkeitsgrenze mit ihren Engpässen ist kein KI-Makel, auf dem sich die Schule mit ihren institutionellen Routinen ausruhen kann. Im Gegenteil führen die bereits bestehenden Fähigkeiten von KI und die hinzukommenden Veränderungen an den Engpässen dazu, dass sich die Verantwortung noch mehr verschiebt. Dort, wo KI stark ist, verliert Schule weiter an Alleinstellungsmerkmalen. Dort, wo KI schwach bleibt, gewinnen pädagogische Professionalität, Haltung und Urteilskraft an Bedeutung.

Für den KI-Ausblick 2026 bedeutet das: Es ist weniger mit flächendeckenden Umbrüchen zu rechnen als mit gezielten Verschiebungen entlang einzelner Engpässe. Wenn diese durch institutionelle Weiterentwicklungen punktuell wegfallen, verändern sich Unterricht und schulische Praxis spürbar. Genau an diesen Stellen braucht es pädagogische Gestaltung und es wird Verantwortung neu ausgehandelt werden müssen.

Veröffentlicht am 1. Januar 2026

[1] Mit Scheitern ist hier gemeint, dass KI-Systeme ihre technischen Potenziale in Schule und Unterricht bei weitem noch nicht ausspielen können. Zudem bestätigten aktuelle Studien (Deutsches Schulbarometer, JIM-Studie, Trendmonitor KI), dass Schüler:innen generative KI deutlich häufiger verwenden als Lehrkräfte und der tatsächliche schulische Einsatz zu wenig systematisiert ist bzw. zu stark vom individuellen Interesse und den Fähigkeiten einzelner Lehrkräfte abhängt.