Überlegungen zur Vermeidung von Oberflächlichkeit im Unterricht

In Fortbildungen berichten Lehrkräfte zunehmend davon, dass viele Schülerinnen und Schüler KI-Tools aller Potenziale zum Trotz dafür nutzen, um sich das Leben leicht zu machen. Das merkt man zum Beispiel dann, wenn Hausaufgaben, die Ergebnisse einer Recherche oder eine Präsentation vorgestellt und erläutert werden sollen. Obwohl die schriftlichen Aufgaben auf den ersten Blick überzeugend wirken, offenbart sich schnell, dass manche Schüler*innen kaum in der Lage sind, die Inhalte zu erklären oder kritisch zu hinterfragen. Es scheint, als wären sie den Verführungen aktueller KI-Systeme zur schnellen Lösung verfallen – ein Problem, das ich auch in meinem eigenen Unterricht zunehmend feststelle.

Die beschriebenen Punkte könnten natürlich eine Art Alltagspragmatismus darstellen oder auf Wissens-, Kreativitäts- und Medienkompetenzdefizite hinweisen. Vielleicht haben die Lernenden die zu erledigenden Aufgaben auch schlicht als sinnlos und/oder den Unterricht als so monoton und langweilig empfunden, dass ihnen der Griff zu KI wie ein Befreiungsschlag vorkommt. Gleichwohl deuten die einheitlichen Erfahrungen vieler Lehrkräfte daraufhin, dass hier (auch) ein neues Bequemlichkeitsmuster vorliegt, mit dem Anstrengungen vermieden werden sollen, obwohl man vielleicht mehr hätte herausholen können. Die dahinterliegende Haltung möchte ich als AI Convenience beschreiben und im Folgenden diskutieren, was das für Schule, Bildung, Didaktik und unseren Umgang mit generativer KI im Unterricht bedeutet. Und welche Lernhaltung wir stattdessen fördern sollten!

Ein neues Bequemlichkeitsmuster mit KI?

AI Convenience beschreibt für mich die Haltung, mit dem zufrieden zu sein, was mit wenig Einsatz aus generativer KI herauszuholen ist. Entscheidend ist dabei die genügsame Bequemlichkeit, sich nicht (mehr) anstrengen zu wollen. Das kann mit Naivität oder mit Berechnung einhergehen, das Ergebnis ist in beiden Fällen Oberflächlichkeit. Der Ausdruck erinnert dabei nicht zufällig an Fertigprodukte/Fertiggerichte (Convenience-Food). Mit Blick auf generative KI passt auch diese Bedeutung. AI Convenience akzeptiert Aufgewärmtes, das andere arrangiert haben. In Kauf genommen wird der Gewinn an Komfort und Zeit bei gleichzeitigem Verlust von Qualität, Tiefe und Individualität.

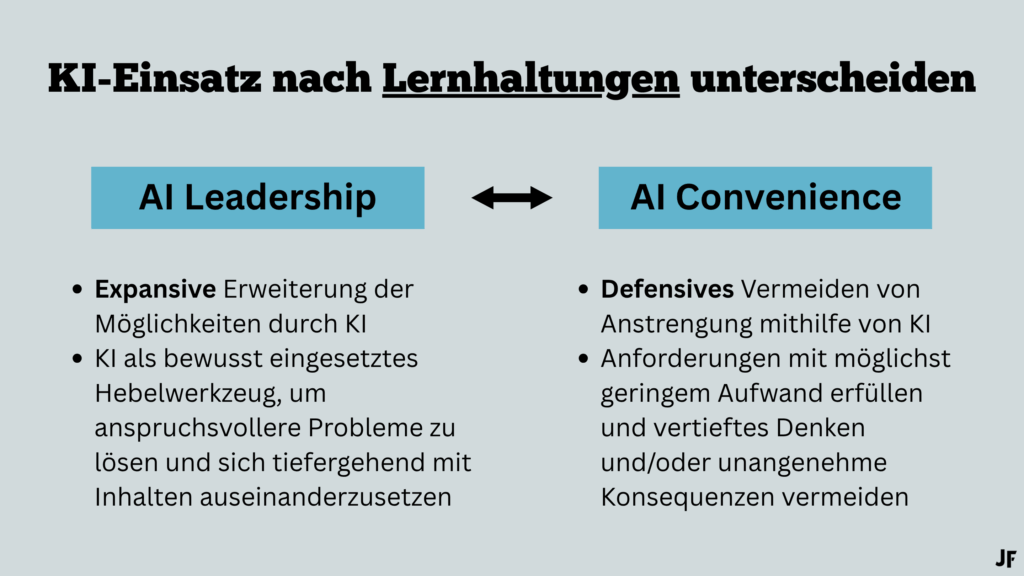

AI Convenience steht damit im Gegensatz zu einer verantwortungsvollen Führungs-, Steuerungs- und Gestaltungskompetenz im Umgang mit generativer KI. Diese haben wir mit dem Begriff AI Leadership (nach Weßels 2024) zuletzt ins Zentrum unseres KI-Kompetenzmodells gestellt (vgl. hier). AI Leadership stellt eine umfassende KI-Kompetenz dar und ist intentional, strategisch, visionär, reflektiert und anspruchsvoll. Dem gegenüber setzt AI Convenience auf kurzfristige Erleichterung – eine Art Komfortzonenmodus.

Ist das verwerflich oder vielleicht sogar clever?

In der Praxis zeigt sich, dass beide Haltungen koexistieren können: AI Convenience kann temporär sinnvoll sein, auch mit Blick auf schulisches Lernen, wenn kurzfristige Entlastung oder Vereinfachung notwendig sind. Problematisch wird dieses Skill Skipping (ein Begriff von Florian Nuxoll, der das Überspringen schulischer Anforderungen treffend auf den Punkt bringt) dann, wenn es dauerhaft zur dominierenden Lernstrategie wird. Die kurzfristige Erleichterung kippt in diesem Fall in eine langfristige Oberflächlichkeit, die den Kompetenzaufbau hemmt oder sogar aktiv untergräbt.

Gibt es dazu Studien?

Michael Gerlich (2025) belegt diesen Effekt auch empirisch. In seiner Studie „AI Tools in Society: Impacts on Cognitive Offloading and the Future of Critical Thinking“ mit 666 Befragten zeigt er, dass das Auslagern kognitiver Prozesse an KI (Cognitive Offloading) signifikant mit schwächerem kritischen Denken korreliert, besonders bei jüngeren Menschen zwischen 17 und 25 Jahren. Gleichwohl beschreibt Gerlich die Zusammenhänge als vielschichtig und regt weiteren Forschungsbedarf an (insbesondere zu Langzeiteffekten des KI-Einsatzes und pädagogischen Interventionsformen, die die Risiken kognitiver Auslagerung durch KI minimieren).

Zu ähnlichen Ergebnissen kommen Forscher*innen der Carnegie Mellon University und von Microsoft Research (Lee et al. 2025). Obwohl dem Einsatz von KI deutliche Effizienzsteigerungen zugeschrieben werden, formulieren die Autor*innen der Studie mehrere Beobachtungen: Die Teilnehmenden konzentrierten sich vor allem auf die Verifizierung von KI-Ergebnissen, eigenständiges Problemlösen geriet zugunsten der Integration von KI-Antworten in den Hintergrund und die Überwachung der KI wurde in Teilen wichtiger als das Lösen der eigentlichen Aufgabe.

Darüber hinaus gelangen auch Barbara Oakley und Kolleg*innen (2025) im Kapitel „The Memory Paradox: Why Our Brains Need Knowledge in an Age of AI“ zu vergleichbaren Schlussfolgerungen. Auf Basis neurowissenschaftlicher und lernpsychologischer Forschung (Literaturanalysen) wird argumentiert, dass das häufige Auslagern von Wissen an digitale Hilfsmittel – etwa durch ständiges Nachschlagen oder die Nutzung von KI – die Ausbildung stabiler Gedächtnisspuren (Engramme) und mentaler Schemata behindert. Dies wiederum schwäche die Fähigkeit zu kritischem Denken und flexibler Problemlösung, da grundlegendes Wissen nicht mehr verinnerlicht, sondern lediglich extern verortet wird.

Was bedeutet das für Unterricht und Lernen?

Mit Blick auf Bildung, Schule und Unterricht muss es darum gehen, solche Deskilling-Effekte zu vermeiden. Diese sind jedoch zu befürchten, wenn Lernende KI unkritisch und mit geringem kognitiven Engagement einsetzen und im schlimmsten Fall die oben skizzierte Haltung ausprägen. Mögliche Antworten sind u. a. in enger didaktischer Begleitung und kognitiv aktivierenden und/oder KI-resilienteren Aufgabenstellungen zu suchen, die sich stärker an der Lebenswelt der Schüler*innen und an zukunftsrelevanten Kompetenzen orientieren. Gerlich empfiehlt zudem, Schüler*innen die Nutzung von KI-Tools so beizubringen, dass kognitive Fähigkeiten dabei nicht vernachlässigt werden.

Um Lernende für eine KI-Nutzung ohne Cognitive Offloading zu sensibilisieren, scheint mir zudem der folgende Ansatz relevant. Aus meiner Sicht sollten wir uns im Unterricht stärker darum bemühen, die Verwendung generativer KI-Tools vor und nach deren Einsatz auf die jeweiligen Nutzungsmotive hin zu reflektieren. Dient ein KI-Chatbot nämlich der Erweiterung der eigenen Möglichkeiten, besteht die Chance auf Kompetenzsteigerung. Dient der KI-Einsatz dem Vermeiden von Anstrengung, werden sehr wahrscheinlich wichtige Lernschritte übersprungen/abgekürzt, was wiederum zum Abbau von (grundlegenden) Kompetenzen führen kann (z.B. bei Schreibaufgaben, die an ein KI-System abgegeben werden). Vielleicht kommt es schlicht darauf an, was ein Schüler/eine Schülerin mit Hilfe von generativer KI erreichen will.

AI Convenience und expansives vs. defensives Lernen

Die Fokussierung der individuellen Motive bietet mit den beschriebenen Zielrichtungen Anknüpfungspunkte an das Konzept des expansiven und defensiven Lernens von Klaus Holzkamp (1993), einem zentralen Vertreter der Kritischen Psychologie. Holzkamp trennt beim bewussten (intentionalen) Lernen grundsätzlich zwei Arten, die sich durch eine unterschiedliche Prämissenlage unterscheiden.

- Expansives Lernen bedeutet, Lernen als selbstbestimmte Erweiterung der eigenen Handlungsmöglichkeiten und Kompetenzen zu begreifen. Es ist intrinsisch motiviert, herausfordernd und auf echte, nachhaltige Kompetenzgewinne ausgerichtet. Lernen dient dem subjektiven Weltaufschluss und wird als sinnvoll erlebt – es geht um die Erhöhung der eigenen Lebensqualität.

- Defensives Lernen hingegen meint, dass Lernhandlungen vor allem darauf abzielen, unangenehme Konsequenzen, Sanktionen oder Anstrengungen zu vermeiden. Lernende reagieren hier auf Druck oder Anforderungen von außen und bleiben oft an der Oberfläche, ohne tiefere Kompetenzen aufzubauen. Sie sind begründetermaßen gezwungen zu lernen.

Mit Blick auf die KI-Revolution des Lernens halte ich diese subjektorientierte Unterscheidung für aktueller denn je. Im Kontext von generativer KI spiegelt AI Leadership eine expansive Lernhaltung wieder: KI wird für Lernhandlungen genutzt, um eigene Kompetenzen und Handlungsoptionen zu erweitern, anspruchsvollere Probleme zu lösen und sich tiefergehend mit Inhalten auseinanderzusetzen. KI ist hier kein einfacher Weg zu schnellen Ergebnissen, sondern ein bewusst eingesetztes Hebelwerkzeug für das eigene Lernen.

Im Gegensatz dazu repräsentiert AI Convenience eine defensive Lernhaltung. Hier steht im Vordergrund, mit möglichst geringem Aufwand Anforderungen zu erfüllen, Anstrengung und vertieftes Denken zu vermeiden. Kurzfristig wirkt das komfortabel, langfristig bleiben aber echte Kompetenzentwicklung und tiefes Verständnis auf der Strecke, da es vordergründig um Bedrohungsabwehr geht. Bei Holzkamp heißt es dazu:

„Ich habe im Banne der defensiven Lernbegründungen zunächst gar kein Interesse daran, meinen lernenden Weltaufschluß [sic] und darüber meine Verfügung/Lebensqualität zu erweitern, sondern bin nur in „unmittelbarkeitsverhafteter“ Weise daran interessiert, der meine Handlungsfähigkeit bedrohenden Konstellation durch Vorweis, Täuschung etc. des erforderten Lernresultats zu entkommen“ (Ders. 1993, S. 246).

Weitere Überlegungen in Richtung einer umfassenden KI-Didaktik…

Während ich noch an diesem Text arbeitete, entdeckte ich zu meiner Freude, dass zwei Autor*innen der PH Zürich ähnliche Gedanken verfolgten. Stefanie Dernbach-Stolz und Dominic Hassler schreiben in ihrem Beitrag ebenfalls über Lernwiderstände und Holzkamps Lerntheorie (Dies. 2025). Sie betonen, dass „Lehrende unreflektierte Anwendungen von KI erkennen und handeln“ müssen. Ihrer Ansicht nach kann das dadurch gelingen, dass Lehrkräfte mit Lernenden über das Lernen sprechen, den Fokus auf den Lernprozess richten und Verantwortung an Lernende übergeben.

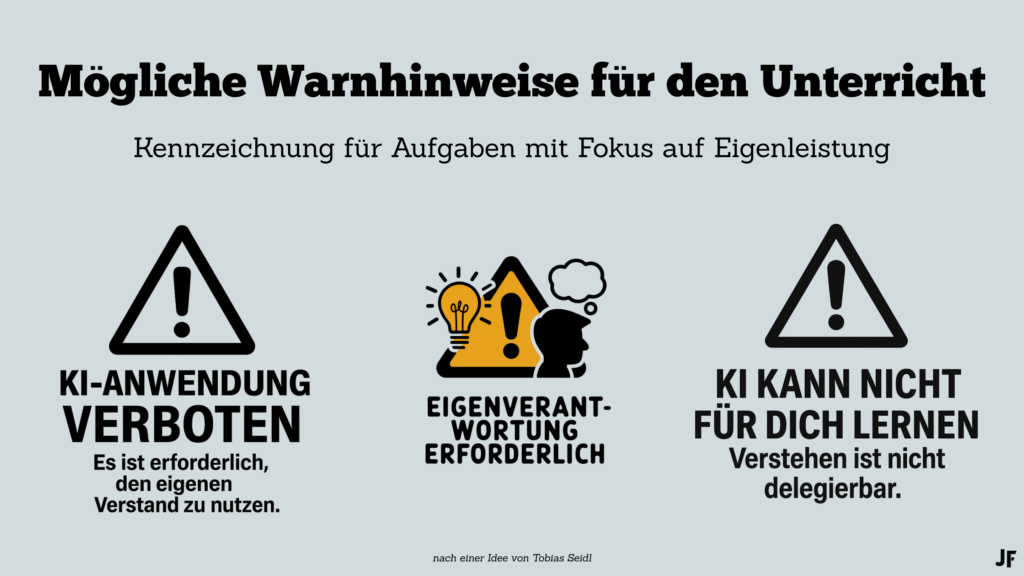

Gut gefällt mir auch die aufgegriffene Idee von Tobias Seidl, der einen Warnhinweis bei Aufgaben anbringt, wenn erst der eigene Verstand gebraucht werden muss, um wichtige Kompetenzen zu erwerben (vgl. auch hier).

Für die konkrete Unterrichtspraxis möchte ich neben Warnhinweisen und der Gestaltung individuell bedeutsamer und expansiver Lernaufgaben (ohne KI/mit punktueller KI-Integration/mit vollumfänglicher KI-Integration, siehe auch unser Leitfaden zur Aufgabenkultur mit KI) insbesondere die folgende Schlussfolgerung unterstützen: Jeder KI-Einsatz sollte mit Blick auf die zugrunde liegende Lernhaltung reflektiert werden. Dazu braucht es unterschiedliche Reflexionsangebote, -aufgaben und -formate, in deren Zentrum Ziele, Motive und Strategien des Lernens stehen müssen. Diese Aufgabe können Lehrkräfte und teilweise/ergänzend auch lernbegleitende und speziell konfigurierte KI-Assistenten übernehmen. Überdies sollten diese Ansatzpunkte als Teilaspekte in Lerncoaching/Lernberatung einfließen.

Reflexionsansätze vor oder nach dem jeweiligen Lernprozess

- Welches Ziel verfolgst du heute?

- Warum ist die Auseinandersetzung mit dem heutigen Thema relevant für dich?

- Was solltest du auf jeden Fall ohne KI schaffen, um dich nicht von einer Maschine abhängig zu machen?

- Welche Strategien und Methoden könnten dir bei der Zielerreichung helfen?

- An welcher Stelle hast du dich für bzw. gegen die KI-Nutzung entschieden und warum?

- An welcher Stelle des Lernprozesses war es besonders wichtig, dass du dich nicht auf eine Maschine verlassen hast?

- An welcher Stellte hat dir der KI-Einsatz geholfen, die Aufgabe tiefer zu durchdringen und/oder neue Kompetenzen zu erwerben?

- Hast du durch die Nutzung der KI neue Lösungswege entdeckt? Welche waren das?

Ziel solcher Reflexionen ist es, Schüler*innen dabei zu begleiten, Lernkompetenzen und insbesondere Lernstrategien für ein planvolles, kritisches und durchdachtes Lernen mit und ohne KI zu entwickeln. Eine bewusst expansive Lernhaltung stellt dabei die Basis für AI Leadership und eine wesentliches Zielkompetenz des selbstregulierten Lernens mit KI dar.

Es braucht eine neue Lernkultur, die expansives lernen fördert

Nun kann man fragen, ob eine solche Lernhaltung in einer typischerweise abarbeitenden Lernkultur eine Chance hat, wenn kaum echte Räume für individuelle und expansive Lernbewegungen eröffnet werden. Eine Lernkultur, in der der Fokus häufig mehr auf Stoff und Prüfungen liegt als auf persönlichen Entwicklungen von Kindern und Jugendlichen bzw. auf dem Lernen selbst. Und in der die Verfügbarkeit von KI die kognitiven Routineaufgaben der bestehenden Lernkultur teilweise ad absurdum führt, sodass AI Convenience fast schon ein gesunder Reflex auf mitunter entfremdete und entfremdende Unterrichts-Routinen ist (Anika Limburg und ich hatten diesen doppelten Entfremdungs-Effekt unter dem Begriff „educational disconnect“ hier diskutiert)[1].

Mit Blick auf die heterogene Schullandschaft in Deutschland lässt sich diese Frage sicher nicht pauschal beantworten. Es scheint mir aber naheliegend, dass eine reformpädagogisch orientierte Lernkultur, die von vornherein auf individuelle Lernwege, Partizipation, Sinnerleben, starke Beziehungen und Selbstorganisation setzt, weniger Convenience-Reflexe hervorruft. Gefragt sind deshalb Schul- und Unterrichtsentwicklungsprozesse hin zu einer Lernkultur für das 21. Jahrhundert, wie man sie bspw. an der preisgekrönten Alemannenschule Wutöschingen beobachten kann. Klar, die Entwicklung einer expansiven Lernhaltung ist auch dort jungen Menschen nicht in die Wiege gelegt. Sie muss geübt und gelernt werden, ist Teil von Beratung und Coaching und braucht nicht nur Rahmenbedingungen, sondern Menschen, die sie leben – insbesondere vor dem Hintergrund der neuen Herausforderungen mit KI. Das gilt natürlich auch für Lehrkräfte, die KI als Aufbruch zur Transformation von Unterricht und Lernen begreifen sollten und nicht ihrerseits mit KI-Fertigmischungen zufrieden sind, z. B. bei der Unterrichtsplanung oder bei schnell zusammengeklickten Übungsmaterialien.

Wie gelingt der nachhaltige Wandel?

Die hier dargestellten Ansätze können konzeptionell und in der konkreten Umsetzung im Unterricht einen ersten Schritt darstellen. Doch ohne flankierende Veränderungen der äußeren Rahmenbedingungen – z. B. hinsichtlich der Raumgestaltung, der Zeitstruktur, bei Lernmaterialien oder Lerngruppen – wird ein nachhaltiger Wandel kaum gelingen. Die mit KI einhergehenden neuen Bequemlichkeitsmuster und die daraus resultierende Tendenz zur Oberflächlichkeit lassen sich vermutlich nur dann durchbrechen, wenn es gelingt, schulische Lernkulturen systematisch weiterzuentwickeln: inspiriert von Good-Practice-Beispielen, gestützt auf Forschung und mit einer konsequenten Förderung von Lernstrategien und Lernkompetenzen mit und ohne KI.

Der Text ist subjektiver Natur, sicher von meiner Alltagswahrnehmung geprägt und als Diskussionsbeitrag mehr ein lautes Nachdenken als eine fertige Analyse. Neben konkreten Überlegungen für die Unterrichtspraxis geht es mir um ein grundsätzliches Verstehen der Auswirkungen von KI auf individuelles Lernen und um geeignete Begriffe, um die jeweiligen Effekte zu beschreiben. Beteilige dich gerne an der Diskussion und hinterlasse deine Meinung/Gedanken in den Kommentaren! Ich freue mich über Feedback und weitere Erfahrungen!

Literatur/Quellen:

- Dernbach-Stolz, S./Hassler, D. (2025): Lernen oder überspringen? Wie generative KI Lernwiderstände verstärken kann. URL: https://blog.phzh.ch/zhe/lernen-oder-uberspringen-wie-generative-ki-lernwiderstande-verstarken-kann/ (zuletzt aufgerufen am 30.6.2025).

- Limburg, A./Falck, J. (2024): Bildungsdisconnect. Wenn Lehrer die Schüler nicht verstehen – und umgekehrt. Gastbeitrag in FAZ Pro Digitalwirtschaft. URL: https://www.faz.net/pro/digitalwirtschaft/transformation/ki-in-der-schule-verschaerft-digitale-kluft-zwischen-schuelern-und-lehrern-110012372.html (zuletzt aufgerufen am 4.7.2025).

- Gerlich, M. (2025): AI Tools in Society: Impacts on Cognitive Offloading and the Future of Critical Thinking. URL: https://www.mdpi.com/2075-4698/15/1/6 (zuletzt aufgerufen am 4.7.2025).

- Holzkamp, Klaus (1993): Lernen. Subjektwissenschaftliche Grundlegung. Campus Verlag Frankfurt/New York. Studienausgabe 1995.

- Lee et al. (2025): The Impact of Generative AI on Critical Thinking: Self-Reported Reductions in Cognitive Effort and Confidence Effects From a Survey of Knowledge Workers. URL: https://dl.acm.org/doi/10.1145/3706598.3713778 (zuletzt aufgerufen am 4.7.2025).

- Nuxoll, F. (2024): Wenn KI das Lernen überholt: Eine Gefahr für die Bildung. URL: https://www.campus-schulmanagement.de/magazin/kolumne/wenn-ki-das-lernen-ueberholt-eine-gefahr-fuer-die-bildung-florian-nuxoll (zuletzt aufgerufen am 4.7.2025).

- Oakley, B. et al. (2025): The Memory Paradox: Why Our Brains Need Knowledge in an Age of AI (May 11, 2025). URL: http://dx.doi.org/10.2139/ssrn.5250447 (zuletzt aufgerufen am 8. Juli 2025).

- Weßels, D. (2024): AI Leadership als Königsdisziplin. In: changement! Das Magazin für Veränderungsprozesse. S. 10-11. URL: https://jimdo-storage.global.ssl.fastly.net/file/2e97e22a-f8d5-4265-8f79-848620a17054/Veröffentlichte-Version_KI%20und%20Change.pdf (zuletzt aufgerufen am 4.7.2025).

Veröffentlicht am 9. Juli 2025

[1] Ansatzpunkte für (radikale) Schulkritik findet man unterdessen auch bei Holzkamp, der Schule in Anlehnung an Foucaults „Überwachen und Strafen“ als Disziplinaranlage beschreibt. Herausgearbeitet werden Aspekte einer „institutionell vergegenständlichten Machtökonomie“, die „Disziplinierung“ und „Parzellierung“ der „Körper“, die „Durchorganisation“ in Schulklassen und die „Fixierung in der Zeit“. Darüber hinaus verweist er auf die „Machttechnik der Prüfung“, die in einer Schule als „pausenlos funktionierender Prüfungsapparat“ zum Einsatz kommt und mit einer „verteilungsorientierten Benotungspraxis“ Abschlüsse als gerecht legitimiert (vgl. S. 349 ff.).

2 thoughts on “Expansives und defensives Lernen in Zeiten von KI”